在当今人工智能技术快速发展的时代,算法模型、计算能力和数据构成了AI系统的三大支柱。尽管深度学习模型和强大的算力备受关注,我们必须清醒地认识到:一切人工智能运作的基础仍然是数据。

数据作为AI系统的“燃料”,其质量、规模和多样性直接决定了人工智能应用的成败。无论是图像识别、自然语言处理还是推荐系统,都需要大量标注或未标注的数据进行训练和优化。没有高质量的数据输入,再先进的算法也难以发挥应有的效能。

在人工智能基础软件开发领域,这一原则体现得尤为明显。基础软件开发者面临着双重挑战:一方面需要构建能够高效处理海量数据的架构和工具,另一方面必须确保数据在采集、存储、处理和传输过程中的安全性与合规性。

优秀的人工智能基础软件应当具备以下特征:

强大的数据管理能力。这包括数据采集、清洗、标注、版本控制和生命周期管理等功能,确保数据在整个AI开发流程中的可用性和一致性。

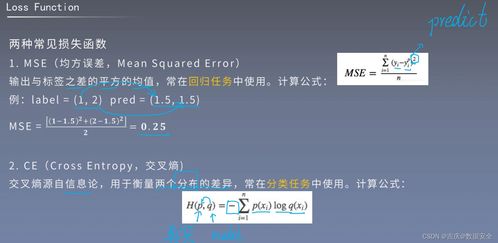

高效的数据处理架构。面对TB甚至PB级别的训练数据,基础软件需要提供分布式计算、并行处理和内存优化等技术,以加速模型训练和推理过程。

完善的数据安全保障。随着数据隐私法规日益严格,基础软件必须内置数据加密、访问控制和匿名化处理等机制,确保敏感信息得到妥善保护。

灵活的数据接口设计。基础软件应当提供标准化的数据输入输出接口,支持多种数据格式和协议,方便与其他系统集成和数据交换。

值得注意的是,数据质量往往比数据数量更为重要。在基础软件开发过程中,开发者需要特别关注数据偏差、标注一致性和样本代表性等问题,避免模型学习到错误的模式或产生歧视性结果。

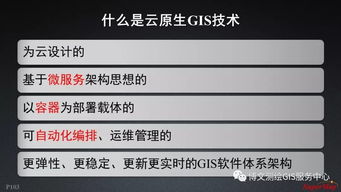

随着边缘计算和物联网的发展,数据来源将更加多样化,数据流动将更加频繁。这要求人工智能基础软件必须具备更强的实时处理能力和更智能的数据调度策略。联邦学习等新兴技术也正在改变传统的数据处理模式,使得在不集中数据的情况下进行模型训练成为可能。

在人工智能时代,数据不仅是起点,更是持续创新的源泉。只有夯实数据基础,构建稳健的数据处理体系,人工智能技术才能真正发挥其变革性的力量,为各行各业带来实质性的进步。人工智能基础软件开发的核心任务,就是为这一数据驱动的未来奠定坚实的技术基石。